Anthropic cede a las demandas del Pentágono y cambia su política de seguridad

La empresa de inteligencia artificial Anthropic ha realizado un giro crucial en sus compromisos de seguridad a raíz de la presión ejercida por el Pentágono de Estados Unidos. Esta modificación supone suavizar sus límites estrictos de seguridad que antes detenían el desarrollo de nuevos modelos de IA si no se cumplían criterios rigurosos.

Presión del Pentágono para acceso militar a IA de Anthropic

El secretario de Defensa estadounidense, Pete Hegseth, habría exigido a Anthropic otorgar acceso irrestricto a su chatbot IA, Claude, para uso militar. Según informaciones, la compañía tiene hasta este viernes para ceder o enfrentarse a sanciones, incluyendo posibles acciones bajo la Ley de Producción de Defensa que obliga a priorizar contratos en nombre de la seguridad nacional.

Anthropic ha ofrecido adaptar sus políticas a los usos militares, pero se niega a permitir el empleo de Claude para vigilancia masiva o armamento sin intervención humana, mostrando una postura firme pese a las amenazas gubernamentales.

De líneas rojas a áreas grises en la seguridad de IA

Hasta ahora, Anthropic mantenía una política de «Responsible Scaling Policy» con reglas estrictas para detener el entrenamiento de IA que pudiera ser inseguro. Sin embargo, ahora la compañía ha reemplazado estos límites duros por «Informes de Riesgo» y «Mapas de Ruta de Seguridad para la frontera tecnológica», que buscan mayor transparencia pública pero permiten más flexibilidad.

Este cambio responde a un problema colectivo motivado por la competencia feroz en el sector de IA y la aproximación regulatoria poco restrictiva en EE.UU., que podría llevar a que los desarrolladores con menos protecciones dicten el ritmo del avance tecnológico, poniendo en riesgo la seguridad global.

Reacciones y preocupaciones sobre el futuro de la seguridad en IA

Expertos en riesgos tecnológicos valoran positivamente la transparencia, pero alertan sobre un posible «efecto de cocción de la rana», donde la ausencia de límites claros podría llevar a una erosión gradual de las medidas de seguridad. Chris Painter, director de METR, destaca que estas modificaciones reflejan la necesidad de reorientar los planes de seguridad ante el avance acelerado de la IA, evidenciando que la sociedad no está preparada para enfrentar los riesgos catastróficos potenciales.

Contexto de la competencia en IA

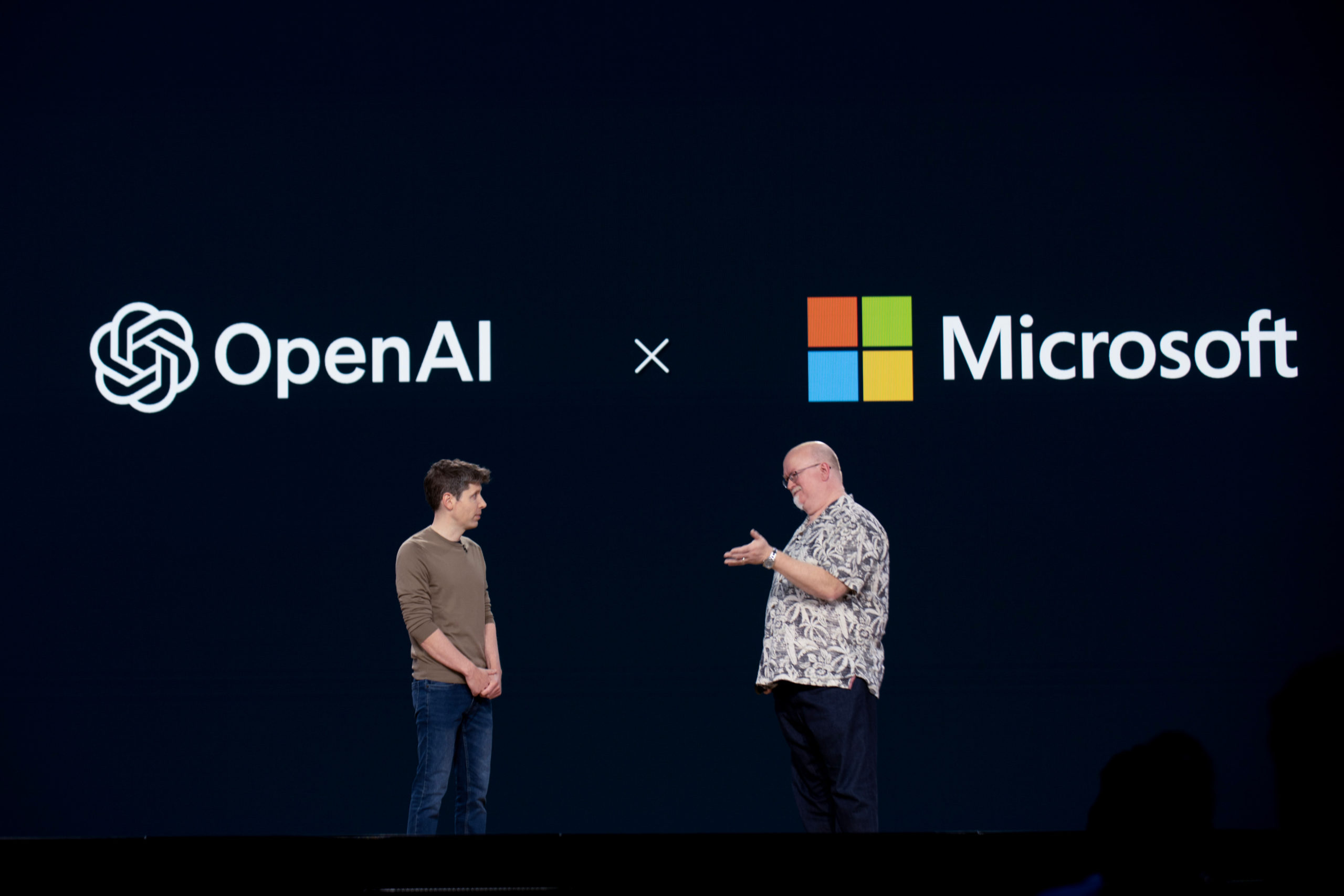

Anthropic, valorada ahora en 380 mil millones de dólares tras una inversión récord de 30 mil millones, compite en un mercado donde OpenAI lidera con una valoración superior a los 850 mil millones. Sus modelos Claude han sido reconocidos especialmente en tareas de programación, pero la presión gubernamental añade complejidad a su desarrollo responsable.

Para más información sobre temas relacionados con la inteligencia artificial y los debates regulatorios, puede visitar nuestro artículo sobre Anthropic enfrenta presión del Pentágono por acceso militar a su IA y mantiene postura firme.

Deja una respuesta