Google revoluciona la generación de imágenes con Nano Banana Pro

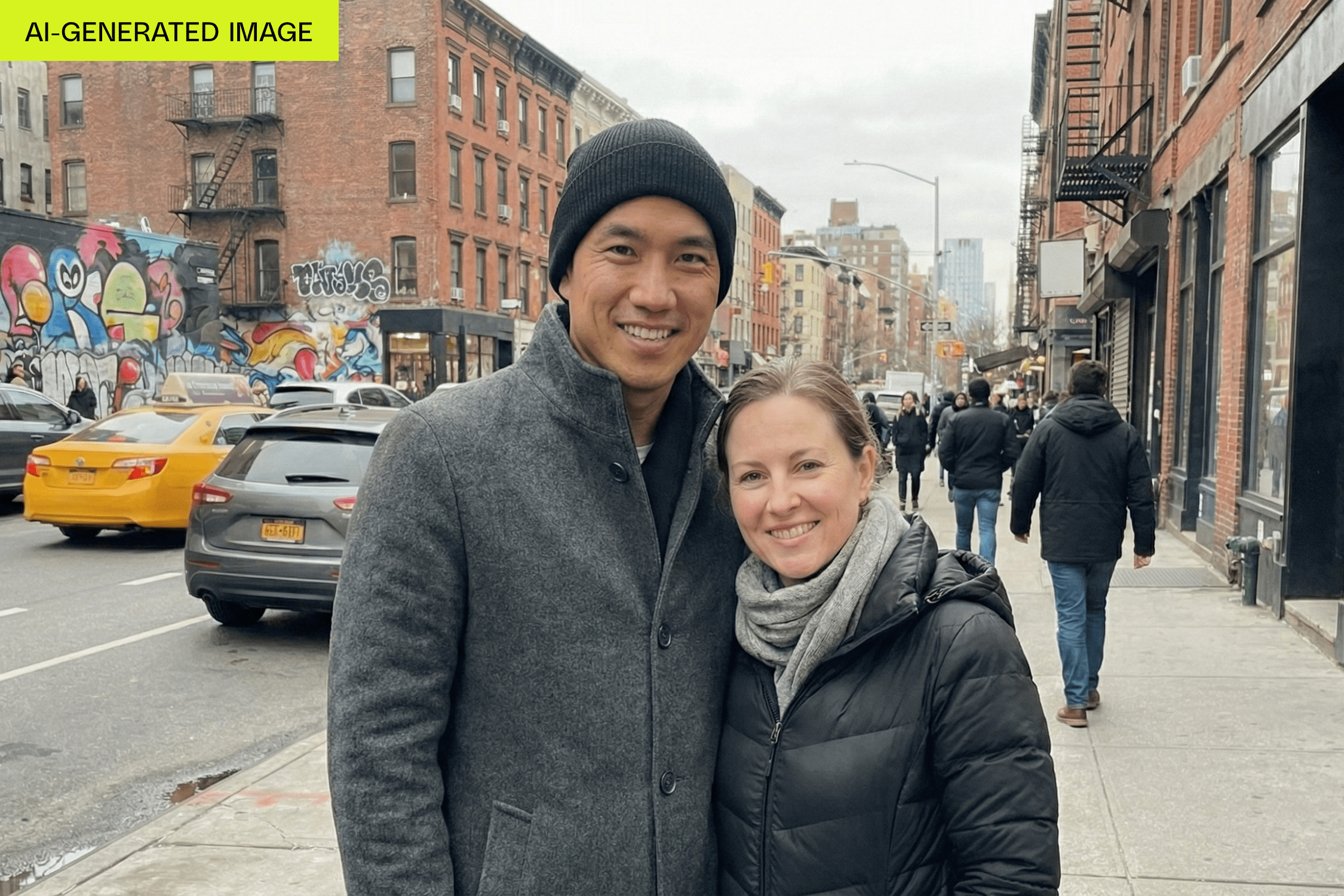

El modelo de inteligencia artificial de Google, Nano Banana Pro, está alcanzando niveles impresionantes en la generación de imágenes que imitan perfectamente las fotos tomadas con teléfonos móviles. Este avance podría transformar la forma en que percibimos la veracidad de las imágenes digitales.

Imágenes realistas con detalles que engañan

Lo que hace especial a Nano Banana Pro es su capacidad para reproducir imperfecciones propias de una cámara de teléfono, como una exposición plana, detalles ligeramente granulados y ruidos característicos, elementos que antes los modelos de IA solían eliminar y que son claves para que una foto parezca auténtica.

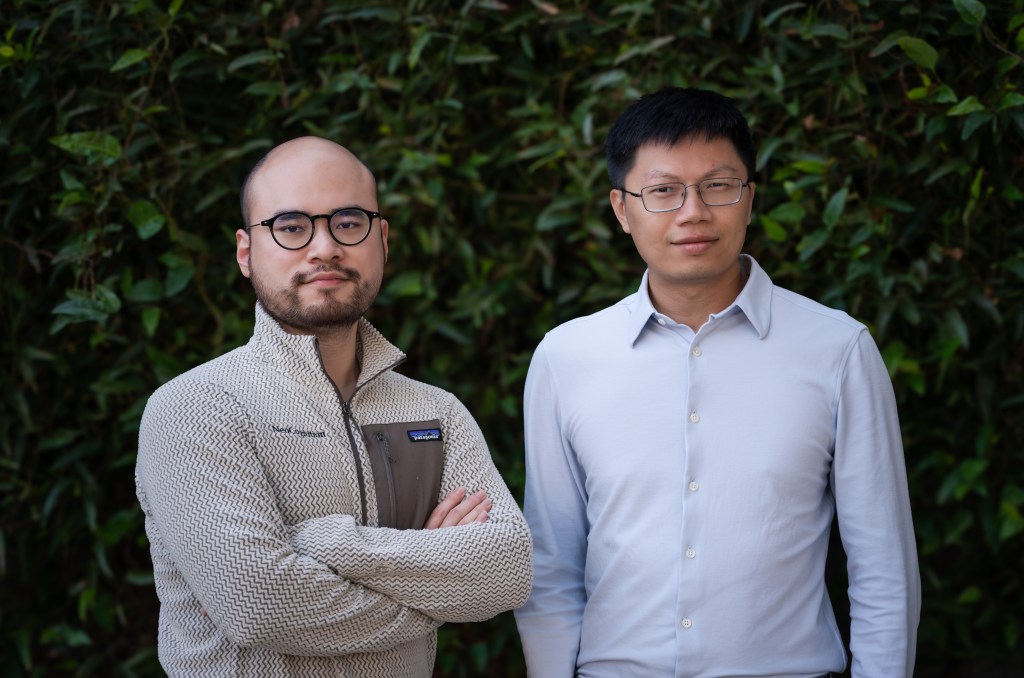

Ben Sandofsky, cofundador de la app para cámaras Halide, explica: «El modelo utiliza un enfoque de ‘afilar agresivamente’ que da vida y realismo a las imágenes, emulando el ‘pop’ visual que suele verse en fotos reales de smartphones». Este nivel de realismo hace difícil para el ojo desprevenido distinguir una imagen generada de una fotografía verdadera.

Contexto y detalles precisos sin necesidad de instrucciones explícitas

Un aspecto innovador es la capacidad del modelo para conectar con búsquedas en Google para agregar información contextual a las imágenes, como objetos, señales y elementos históricos. Por ejemplo, al pedirle una imagen de una casa estilo Craftsman en West Seattle, añadió automáticamente detalles como marcas de agua de servicios inmobiliarios y años específicos, sin que el usuario los solicitara.

Según Naina Raisinghani, gerente de producto en DeepMind, estas «alucinaciones» de la IA a menudo se interpretan como errores, pero en este caso suponen justamente la intención del modelo de incluir detalles para aumentar la autenticidad visual.

Implicaciones y preocupación por la veracidad digital

Este nuevo nivel de realismo en imágenes de IA plantea desafíos significativos para la confianza en el contenido visual que circula en redes y medios digitales. Allison Johnson, periodista experta en fotografía móvil, advierte que resulta cada vez más difícil identificar señales típicas de imágenes generadas por IA, lo que podría afectar la forma en que consumimos información visual.

Para protegerse, es recomendable activar alertas o filtros para detectar contenido generado por IA y ser cautelosos con imágenes sospechosas o de fuentes poco fiables.

Más sobre el avance en IA visual

Si te interesa la evolución de la inteligencia artificial en el ámbito visual y su impacto en la tecnología, te recomendamos leer nuestro artículo sobre ChatGPT y su transformación en el mercado tecnológico.

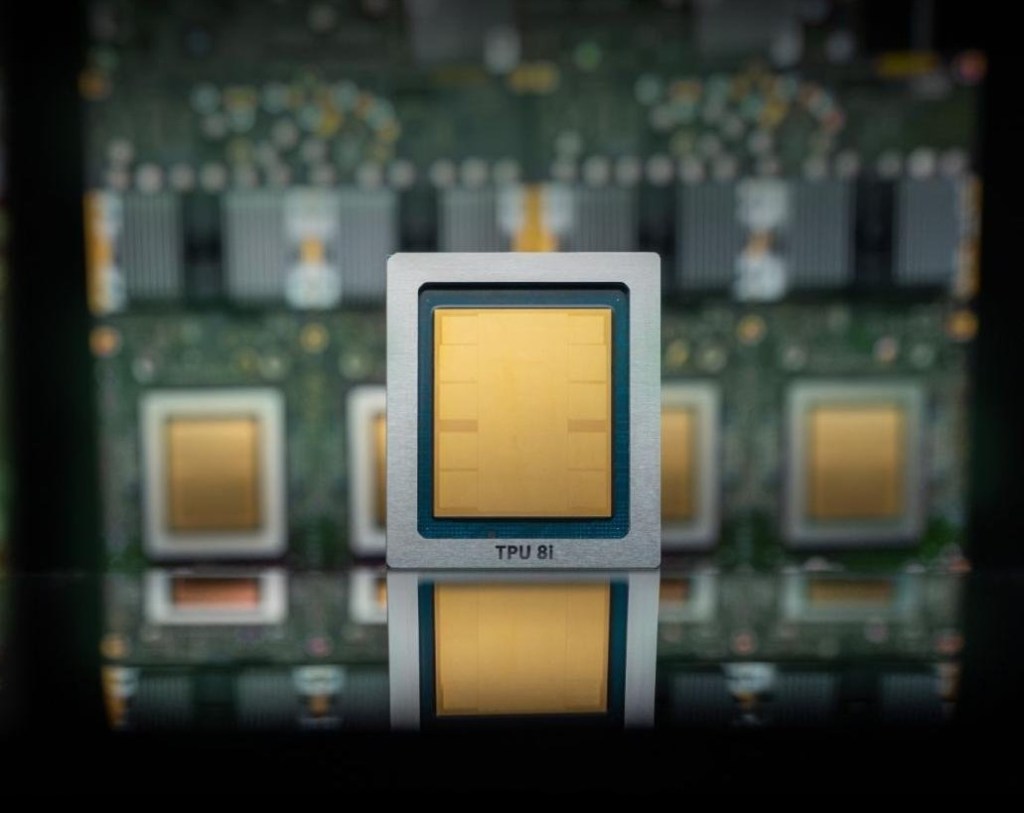

Para más información técnica y análisis profundo, puedes consultar la página oficial de DeepMind y los recursos sobre Google Gemini, el motor que impulsa Nano Banana Pro.

Deja una respuesta